近年、生成AIをはじめとするAI技術の進展により、組織におけるAIの活用は急速に広がっています。本記事では、IPA「情報セキュリティ10大脅威 2026」の内容をもとに、AIの利用をめぐるサイバーリスクについて整理するとともに、企業に求められる対応の方向性について解説します。

IPA「情報セキュリティ10大脅威」速報版の記事はこちら。「AIの利用をめぐるサイバーリスク」以外の脅威の項目についても知りたい方は、こちらもぜひあわせてご覧ください。

「【速報版】情報セキュリティ10大脅威 2026 -脅威と対策を解説-」

はじめに

業務効率の向上や新たな価値創出の手段として、多くの企業がAIの導入を進めています。一方でAI利用に伴うリスクについても、十分な注意が求められています。こうした状況を反映して、IPA(独立行政法人情報処理推進機構)が公表した「情報セキュリティ10大脅威 2026」において、「AIの利用をめぐるサイバーリスク」という脅威が初めてランクインし、3位に位置付けられました。

なぜいま「AIの利用」が脅威として注目されるのか

IPA「情報セキュリティ10大脅威」は、前年に発生した社会的影響の大きい事案等をもとに選定されたものであり、順位は単純に危険度の高さを示すものではありません。しかし、AI利用に関するリスクが新たに選出されたことは、企業や組織におけるAI活用の拡大と、それに伴う課題の顕在化を示すものといえるでしょう。

2026年3月12日に公開された、IPA「情報セキュリティ10大脅威 2026」解説書では、AIは有用なツールである一方で、十分な理解がないまま利用した場合、情報漏洩や権利侵害といった問題につながる可能性があると指摘されています。特に、生成AIへの入力内容が外部に取り扱われることによる機密情報の漏洩や、生成された情報の正確性を確認せずに業務に利用することによって発生するトラブルなど、従来の情報システム利用とは異なる観点でのリスクが挙げられています。 また、AIは利用者の裾野が広く、専門的な知識がなくても活用できるという特性を持っています。そのため、組織として利用状況を把握しきれないまま、個人単位で業務利用が進むケースも想定されます。このような利用形態は、管理の行き届かないリスク、いわゆるシャドーITに類似した問題を引き起こす可能性があります。

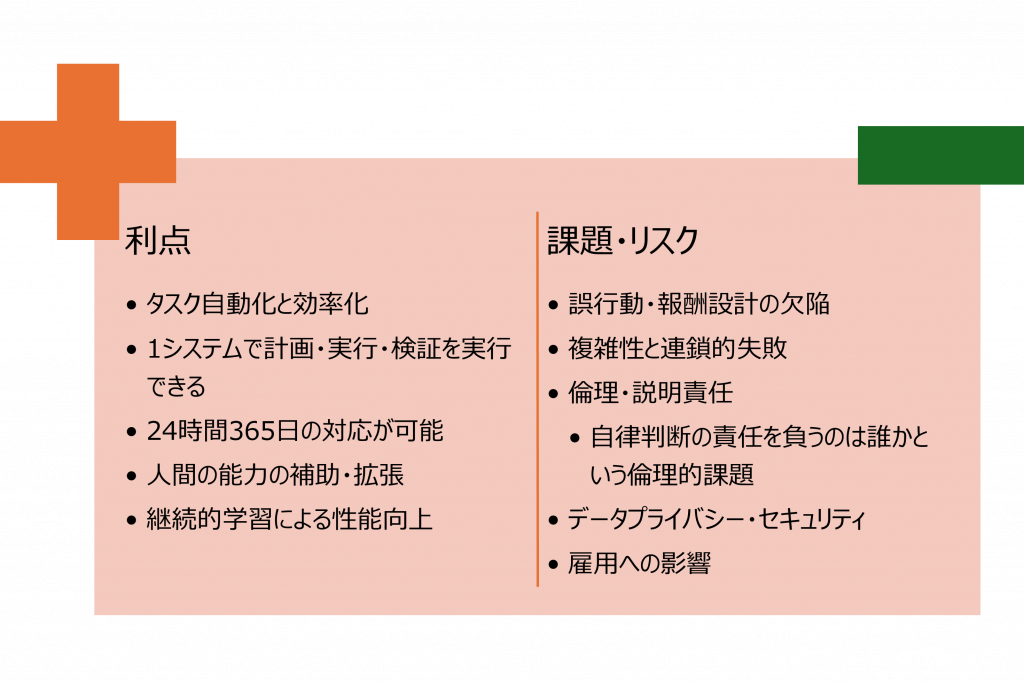

AI利用をめぐる主なリスク

IPAはAIの利用拡大に伴い、いくつかの代表的なリスクが指摘しています。これらは、AIの技術そのものというよりも、その利用方法や特性に起因するものが多い点が特徴です。

- 情報漏洩リスク

- 誤情報生成リスク(ハルシネーション)

- サイバー攻撃の高度化リスク

- 利用実態の把握困難(シャドーAI)

- 権利侵害リスク

生成AIへの入力内容に起因する情報漏洩

クラウドサービスとして提供されるAIに対し、機密情報を入力することで、意図せず外部に情報が送信される可能性があるというリスクです。

AIの出力結果に関するリスク

対話型AIは実在しない情報を生成する(=ハルシネーション)場合があり、このことを十分に理解せずに利用すると、誤った判断や誤情報発信につながるおそれがあります。

AIの悪用によるサイバー攻撃の高度化

AIを活用することで、攻撃の効率化や手口の巧妙化が進む可能性があります。さらに、組織における利用実態の把握が難しい点も重要なリスクです。

シャドーAIのリスク

個人単位でAIサービスを利用されてしまうことで、組織の目の届かない範囲での利用が発生する可能性があります。

著作権侵害などの権利問題

AIの利用に関する理解不足により、著作権侵害などの権利問題が生じる可能性も指摘されています。

AI利用において想定される主な事例

AI利用に伴うリスクは、特別な環境でのみ発生するものではなく、日常業務の中で自然に発生し得るものです。例えば業務の効率化を目的として、従業員が個人で利用している生成AIサービスを業務に活用するケースが考えられます。メール文面の作成や資料作成の補助としてAIを利用する延長で、社内資料の内容や顧客情報をそのまま入力してしまうことがありえます。生成AIはクラウド上で動作しており、入力した内容はサービス側で処理されます。場合によっては、入力内容がサービスの改善や学習に利用されることもありえます。この点を十分に理解しないまま利用すると、機密情報を外部サービスに送信してしまうことになり、情報漏洩につながるおそれがあるのです。

また、対話型AIの回答をそのまま精査せずに業務に利用してしまうことで問題に発展する可能性もあります。調査や資料作成の過程でAIが生成した情報を十分に確認せずに利用した結果、ハルシネーションの内容を含んだまま社内外に共有してしまうといった事態が起こり得ます。このように、AI利用に伴うリスクは特定の専門領域に限らず、日常業務の延長線上で発生する点に特徴があります。

組織における課題

AIの利用が広がる一方で、組織としてこれらのリスクを適切に管理することにはいくつかの課題があります。

社内でのAI利用の促進とルールの策定のバランス

まず、AI利用に関するルールやガイドラインの整備が追いついていない点が挙げられます。現場での利用が先行する中で、組織としての利用方針が明確でない場合、統一的な管理が難しくなります。また、利用状況の把握が困難であることも大きな課題です。クラウド型のAIサービスは個人単位で容易に利用可能なため、組織として誰がどのように利用しているかを正確に把握することが難しくなります。実際には、想定以上に広範囲で利用が進んでいるケースも少なくありません。さらに、ポリシーを整備しても現場に浸透しないという課題もあります。AIは業務効率の向上に直結するため、利便性を優先してルールが守られないケースや、現場ごとに独自の運用が行われるといった状況も発生し得ます。加えて、AI利用と既存のセキュリティ対策との間にギャップが生じる点も課題です。従来のセキュリティ対策は想定していなかった利用形態が増えることで、管理や統制が追いつかない場面が生じる可能性があります。さらに、利用者への教育不足も課題の一つです。AIの特性やリスクに関する教育や周知が十分でないために、組織として意図しない利用が広がり、統制が効かなくなるおそれがあります。

このように、AIの活用においては、ルール整備や利用状況の把握といった基本的な対応に加え、実際の運用における課題も踏まえた継続的な対応が求められます。

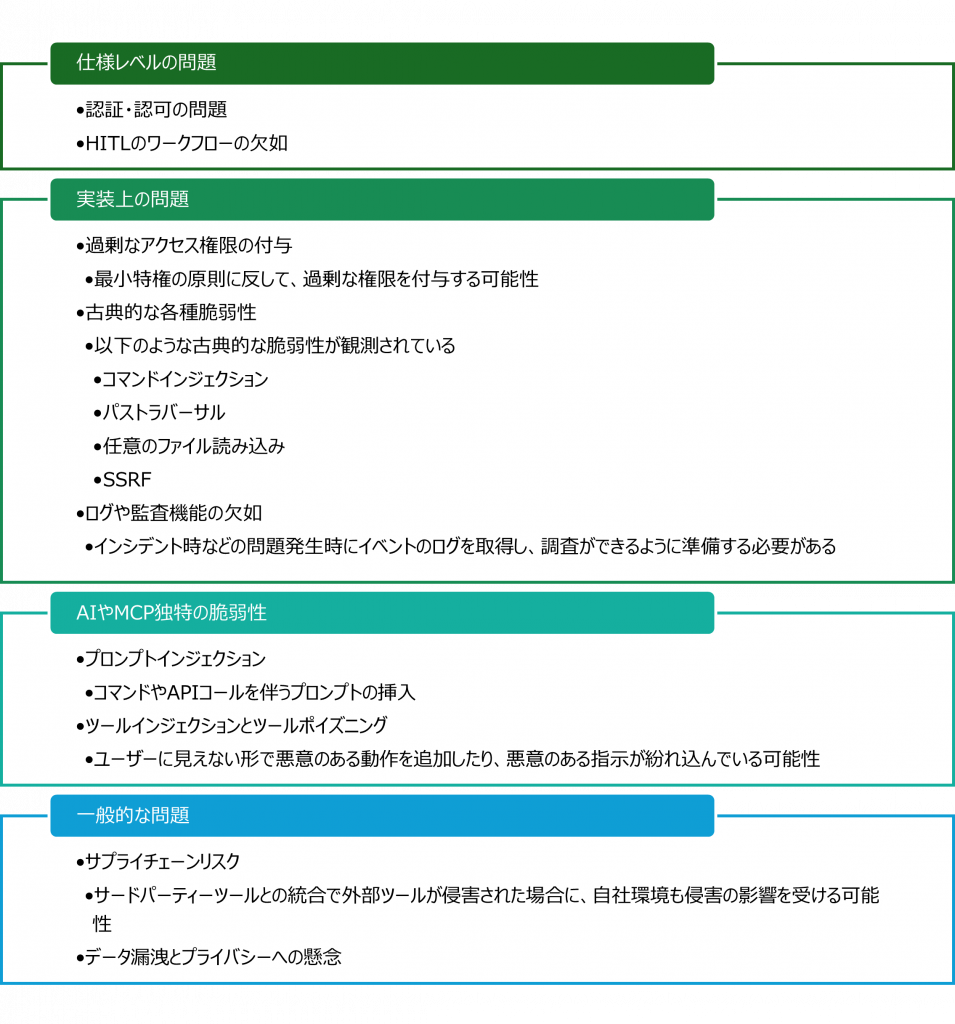

企業が取るべきアクション

AIの利用に伴うリスクに対応するためには、個別の技術対策にとどまらず、組織としての管理と運用の整備が重要となります。AI利用に関しては、ルール整備や教育、基本的なセキュリティ対策の徹底といった観点での対応が求められています。

- AIの利用に関するルールやガイドラインの整備

どのような用途でAIを利用してよいのか、入力してよい情報の範囲、利用してはならない行為などを明確に定めることで、利用に伴うリスクを一定程度抑制することが可能となります。 - 利用状況の把握と管理

AIサービスは個人単位でも容易に利用できるため、組織としてどのように利用されているかを把握し、必要に応じて管理の対象とすることが重要です。これにより、管理の行き届かない利用、いわゆるシャドーAIの発生を抑制することが期待されます。 - AI利用者への教育

AIの特性やリスクについて正しく理解させることで、生成結果の確認や適切な情報の取り扱いといった基本的な行動を促すことができます。技術的な制御だけでなく、利用者の理解を前提とした運用が不可欠です。 - 基本的なセキュリティ対策の徹底・見直し

認証の適切な運用や情報管理の強化といった既存の対策は、AI利用においても引き続き基盤となるものです。その上で、AIの利用が業務に広く組み込まれる中では、従来の対策だけでは対応しきれない場面も想定されるため、AI利用を前提としたセキュリティの見直しや再設計が必要となる可能性もあります。

このように、AIの安全な活用には、ルール、管理、教育、AIを前提とした基本的なセキュリティ対策といった複数の観点からの継続的な取り組みが重要です。

AI時代に求められるセキュリティ支援

こうした課題に対応するためには、組織単独での取り組みだけでなく、専門的な支援の活用も有効です。以下のようなセキュリティ支援の例が挙げられます。

- セキュリティ診断・リスクアセスメント

AI利用に伴うリスクを把握するためのセキュリティ診断やリスクアセスメントが重要となります。現状の利用状況や潜在的なリスクを可視化することで、適切な対策の検討につなげることができます。 - 運用監視体制の強化

AIの利用状況を継続的に監視し、問題の早期発見や対応を行う体制を整備することで、リスクの低減が期待されます。 - AI利用ガイドライン策定支援

組織の実態に即したルールを整備し、現場で実際に運用可能な形に落とし込むことが求められます。

さいごに

「情報セキュリティ10大脅威 2026」において、「AIの利用をめぐるサイバーリスク」が新たにランクインしたことは、AI活用の拡大と、それに伴う課題の顕在化を示すものといえます。AIに関するリスクは、新たな技術そのものに起因するというよりも、その利用方法や理解不足に起因する側面が大きい点が特徴です。そのため、対策としては、ルール整備や利用状況の把握、教育といった組織的な対応に加え、基本的なセキュリティ対策を継続して実施することが重要となります。

また、IPAが示す通り、10大脅威の順位は危険度の高さを示すものではなく、自組織の状況に応じて適切にリスクを評価し、優先順位を定めて対策を講じることが求められます。 AIの活用は今後さらに進むことが想定されますが、その利便性を最大限に活かすためにも、リスクを正しく理解し、組織として適切に管理・運用していくことが重要です。

【関連ウェビナーのご案内】

本記事では、生成AIの利用に伴うサイバーリスクと、企業への影響について整理しました。AIの活用が進む一方で、情報漏えいや誤利用、統制の難しさといった課題が現実のものとなっています。では、こうしたリスクは実際にどのように悪用され、どのような攻撃として現れているのでしょうか。2026年4月15日に開催のウェビナーでは、生成AIを悪用した具体的な事例をもとに、サイバー脅威の実態と防御戦略を詳しく解説します。リスクの「背景」だけでなく、「実際に何が起きるのか」を理解したい方は、ぜひご参加ください。

ウェビナー最新情報はこちら

BBSecでは

当社では様々なご支援が可能です。お客様のご状況に合わせて最適なご提案をいたします。当当サイトSQAT® jpのお問い合わせページよりお気軽にお問い合わせください。後日営業担当者よりご連絡させていただきます。

SQAT® 脆弱性診断

BBSecの脆弱性診断は、精度の高い手動診断と独自開発による自動診断を組み合わせ、悪意ある攻撃を受ける前にリスクを発見し、防御するための問題を特定します。Webアプリケーション、ネットワークはもちろんのこと、ソースコード診断やクラウドの設定に関する診断など、診断対象やご事情に応じて様々なメニューをご用意しております。

SQAT® ペネトレーションテスト

「ペネトレーションテスト」では実際に攻撃者が侵入できるかどうかの確認を行うことが可能です。脆弱性診断で発見したリスクをもとに、実際に悪用可能かどうかを確認いたします。

編集責任:木下

Security NEWS TOPに戻る

バックナンバー TOPに戻る