企業のIT環境は、もはや社内サーバーやネットワーク機器だけで完結しません。業務システムはクラウドへ移行し、開発現場ではOSSの利用が当たり前になり、SaaSやコンテナ、API連携を含めた複雑な構成が一般化しています。こうした環境では、ひとつの脆弱性が単独の問題にとどまらず、情報漏えい、業務停止、サプライチェーン全体への影響へとつながることがあります。だからこそ今、多くの企業にとって重要になっているのが「脆弱性管理」です。

脆弱性管理とは、脆弱性を見つけることそのものではありません。自社にどの資産があり、どこに弱点があり、それがどの程度危険で、いつまでに何を直すべきかを継続的に判断し、実際に改善し続ける運用を指します。本記事では、脆弱性管理の基本から、企業が実務で押さえるべき流れ、ツールの考え方、クラウドやOSS時代に欠かせないSBOMの活用まで、2026年時点の実務に沿って整理します。

脆弱性管理とは

脆弱性管理とは、システムやソフトウェア、クラウド環境、ネットワーク機器などに存在するセキュリティ上の弱点を継続的に把握し、評価し、修正し、再確認する一連の運用です。単発の診断や一度きりの点検ではなく、変化し続けるIT環境に合わせて回し続けることに意味があります。CISAも、脆弱性管理を「脆弱性や悪用可能な状態の発生頻度と影響を減らす取り組み」と位置づけています。

脆弱性管理では、日々公開される脆弱性情報を継続的に確認することが重要です。多くの脆弱性は CVE(Common Vulnerabilities and Exposures) という識別番号で管理されています。CVEの仕組みについては、以下の記事で詳しく解説しています。

「CVEとは?脆弱性情報の共通識別番号を解説」

CVEは、公開されたサイバーセキュリティ上の脆弱性を識別し、共通の参照先として扱うための仕組みです。一方、NVDはそのCVE情報に対してCVSSなどの評価情報や関連データを付与し、脆弱性管理の自動化や優先順位付けに役立つデータベースとして機能しています。つまり実務では、「CVEで対象を識別し、NVDやベンダー情報で内容と深刻度を確認する」という流れが基本になります。

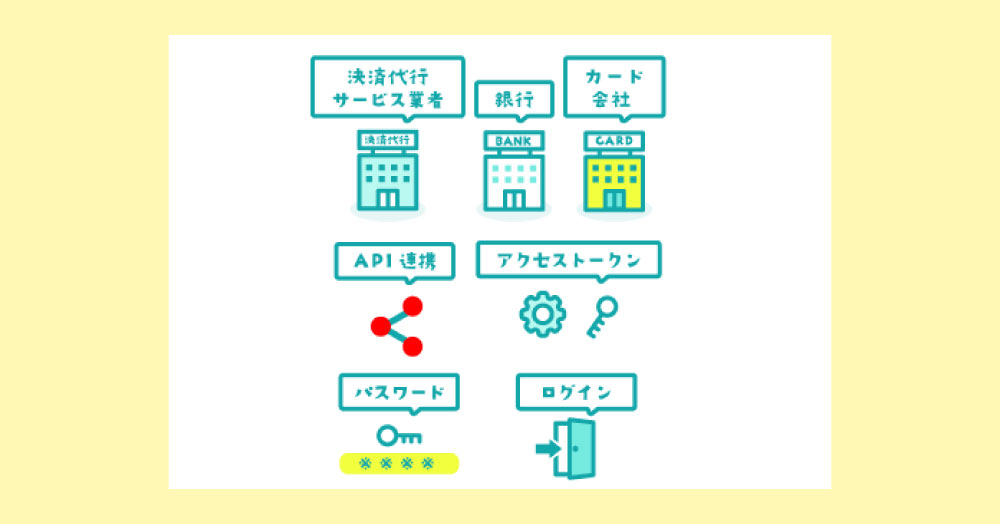

現在の企業システムは、オンプレミス環境だけでなく、AWS・Azure・Google Cloud などのクラウド環境やSaaSサービスを組み合わせて構築されるケースが増えています。そのため、脆弱性管理はサーバーやネットワークだけでなく、クラウド環境やソフトウェアコンポーネントも含めて実施する必要があります。クラウドでは、基盤の一部は事業者が管理していても、設定、アクセス権、ゲストOS、コンテナイメージ、アプリケーションなどは利用企業側の責任範囲に残るためです。AWS、Microsoft、Google Cloudはいずれも共有責任モデルを明示しており、利用者側の継続的な管理を前提にしています。

なぜ企業に脆弱性管理が必要なのか

企業に脆弱性管理が必要な最大の理由は、脆弱性が「見つかっただけの情報」ではなく、「実際に悪用される入口」になっているからです。公開された脆弱性のすべてが直ちに攻撃に使われるわけではありませんが、CISAは実際に悪用が確認された脆弱性を Known Exploited Vulnerabilities(KEV) Catalog として公開し、組織に優先対応を促しています。つまり現代の脆弱性管理では、公開情報を眺めるだけでなく、「いま悪用されているか」「自社に影響するか」を見極めることが重要です。

脆弱性を放置するリスクも明確です。攻撃者は、修正が遅れたVPN機器、公開サーバー、業務アプリケーション、ミドルウェア、コンテナ環境などを足がかりに侵入し、そこから権限昇格や横展開を進めます。問題は、重大な脆弱性があっても、自社資産を把握できていなければ「影響を受けているのに気づけない」ことです。脆弱性管理は、修正作業の前段として、自社に何が存在しているかを見える化する意味でも不可欠です。

さらに、近年はOSS利用の拡大によって、ソフトウェアサプライチェーン全体のリスク管理が重要になっています。NTIAはSBOMを、ソフトウェアを構成する各種コンポーネントとそのサプライチェーン上の関係を記録する正式な記録と説明しています。OSSライブラリや依存パッケージに脆弱性が含まれていた場合、アプリケーション本体に問題がなくても、企業システム全体に影響が及ぶ可能性があります。これが、いわゆるソフトウェアサプライチェーンリスクです。

クラウド利用の拡大も、脆弱性管理の必要性をさらに高めています。クラウド環境では、サーバーを一度構築して終わりではなく、構成変更、イメージ更新、コンテナ再配備、アクセス制御変更などが高頻度で発生します。そのため、脆弱性管理を継続的に実施しなければ、未更新のソフトウェアや脆弱なイメージ、設定不備がそのまま攻撃対象になる可能性があります。共有責任モデルのもとでは、クラウド事業者がすべてを守ってくれるわけではありません。自社が責任を持つ範囲を理解し、そこを継続的に点検する必要があります。

脆弱性管理の基本プロセス

脆弱性管理の基本プロセスは、一般に以下のような流れです。

- 脆弱性の発見

- 脆弱性評価

- 修正

- 検証

ただし実務では、前提としてソフトウェア資産の把握が欠かせません。なぜなら、何を保有しているか分からない状態では、脆弱性情報を受け取っても影響判断ができないからです。NVDのような脆弱性データベースは、脆弱性管理の自動化や評価に使える標準化データを提供していますが、それを生かすには自社資産との突合が必要です。

脆弱性の発見は、公開情報の確認だけでなく、スキャンツール、構成管理情報、ベンダーアドバイザリ、クラウドのセキュリティ機能など、複数の情報源を組み合わせて行います。次に必要になるのが評価です。ここではCVSSのような一般的な深刻度だけでなく、インターネット公開の有無、業務影響、悪用実績、代替策の有無、修正難易度などを踏まえて、自社にとっての優先度を決める必要があります。NVDも、CVSSは深刻度の定性的な指標であり、リスクそのものではないと明示しています。

その後、実際に修正を行います。修正方法は、パッチ適用、設定変更、バージョンアップ、アクセス制御の見直し、機能停止、ネットワーク遮断などさまざまです。最後に、修正後の検証を実施し、本当に脆弱性が解消されたか、別の不具合を生んでいないかを確認します。この「修正して終わりにしない」ことが、脆弱性管理を単なる作業ではなく運用として成立させるポイントです。脆弱性管理では、まず自社のIT資産を正確に把握することが重要です。対象にはサーバーやネットワークだけでなく、クラウド環境、利用しているOSSライブラリなども含まれます。

IT資産管理と脆弱性管理の関係については、以下の記事で詳しく解説しています。

「脆弱性管理とIT資産管理とは?サイバー攻撃から組織を守る取り組み」

近年では SBOM(Software Bill of Materials) を利用してソフトウェア構成を可視化する企業も増えています。SBOMは、ソフトウェアに何の部品が含まれているかを一覧化する考え方で、影響範囲の特定や依存関係の把握に有効です。

「SBOMとは?ソフトウェア部品表の基本と企業が導入すべき理由」

脆弱性管理のフロー(実務)

実務に落とし込むと、脆弱性管理の流れは以下のような順番で整理することができます。

- 脆弱性情報の収集

- クラウド・OSSへの影響確認

- 優先度判断

- 修正

- 再確認

まず行うべきは、CVE、ベンダーアドバイザリ、クラウドベンダー通知、各種セキュリティ情報の収集です。ここで漏れがあると、そもそも対応のスタート地点に立てません。CISAは、実際に悪用が確認された脆弱性についてKEV Catalogの確認と優先的な是正を強く推奨しています。

次に必要なのが、収集した情報が自社環境に関係するかどうかの確認です。オンプレミス機器だけなら比較的見通しが立ちますが、現在はクラウド上のワークロード、コンテナ、OSSライブラリ、CI/CDで取り込んだ部品まで視野に入れなければ、実態を取り逃がします。とくにOSS脆弱性は、アプリケーション本体よりも深い依存関係に潜んでいる場合があり、SBOMやSCAの仕組みがないと把握が難しくなります。

優先度判断では、CVSSの高さだけで対応順を決めないことが重要です。CVSSは比較の基準になりますが、公開サーバーにあるのか、認証が必要なのか、すでに悪用実績があるのか、業務停止時の影響はどれほどかによって、実際の対応順は変わります。NVDもCVSSをリスクそのものではないと説明しており、KEVのような実悪用情報と組み合わせて判断するのが現実的です。

修正段階では、パッチ適用だけに視野を限定しないことが大切です。クラウド環境では、OSやミドルウェアの更新に加え、コンテナイメージの差し替え、設定変更、公開範囲の見直し、権限調整なども重要な対策になります。修正後は再スキャンや設定確認を行い、実際に解消されたことを確認します。ここで検証が不十分だと、「対応したつもり」で終わってしまい、後になって再発見されることがあります。

脆弱性管理では、脆弱性を発見するだけでなく、発見された脆弱性に対して迅速に対応することが重要です。適切な脆弱性対応を行わなければ、攻撃者に悪用され、情報漏えいやシステム停止などの重大なインシデントにつながる可能性があります。脆弱性対応の基本的な流れや実務での対応方法については、以下の記事で詳しく解説しています。

「脆弱性対応とは?CVE対応とパッチ管理の実務フロー」

近年ではクラウド環境やOSSライブラリに含まれる脆弱性の影響調査も重要になっています。SBOMを利用すると、影響範囲を迅速に把握できます。

脆弱性管理ツールの種類

脆弱性管理を実務で回すには、ツールの力を借りることが現実的です。ただし、ひとつの製品で全領域を完全にカバーできるとは限りません。一般的な脆弱性スキャナーは、ネットワーク機器、サーバー、OS、ミドルウェア、Webアプリケーションの既知脆弱性を見つけるのに有効ですが、OSSライブラリの依存関係やソフトウェア部品表までは十分に扱えないことがあります。そこで、管理ツール、クラウドセキュリティツール、SBOM管理ツール、SCAツールなどを役割ごとに組み合わせる設計が必要になります。

たとえば、CSPMやCNAPPのようなクラウド向けツールは、クラウド設定やワークロードの状態を継続的に可視化するのに向いています。一方、SCAはアプリケーションが依存しているOSSコンポーネントを洗い出し、既知脆弱性との突合を支援します。SBOM管理ツールは、その構成情報を継続管理し、影響調査を効率化する役割を持ちます。2026年の脆弱性管理では、ネットワークやサーバーだけを見ていても不十分で、クラウドとソフトウェアサプライチェーンまで含めた多層的な可視化が必要です。

OSSの脆弱性を管理するために、SCA(Software Composition Analysis)ツールやSBOM管理ツールを導入する企業も増えています。これは、ソフトウェアの構成部品とその依存関係を可視化しなければ、OSS由来の脆弱性が自社に影響するかどうかを迅速に判断しにくいためです。NTIAも、SBOMをソフトウェア構成要素の透明性向上に役立つ仕組みとして整理しています。

SCA(Software Composition Analysis)ツールとは

ソフトウェアに含まれるオープンソースや外部ライブラリの構成要素を解析し、既知の脆弱性やライセンスリスクを可視化するセキュリティツールです。依存関係を自動的に検出し、CVEなどの脆弱性データベースと照合することで、潜在的なリスクを早期に特定できます。また、ライセンス違反の有無も確認でき、コンプライアンス対応にも有効です。開発プロセスに組み込むことで、セキュアで安全なソフトウェア開発を支援します。

脆弱性スキャンについてはこちらの記事でも詳しく解説しています。

「今さら聞けない脆弱性とは-基礎から学ぶ脆弱性管理と効果的な脆弱性対策ガイド-」

企業の脆弱性管理の課題

多くの企業が脆弱性管理に苦労する理由は、脆弱性そのものより、管理対象の広がりにあります。

IT資産の把握

まず大きいのが、IT資産の把握が難しいことです。クラウド移行、テレワーク、SaaS利用、部門独自導入のツール、コンテナ活用が進むと、情報システム部門が把握していない資産が生まれやすくなります。この状態では、脆弱性情報を受け取っても、自社への影響有無を正確に判断できません。

OSS依存関係の管理

現代のソフトウェアは、直接導入しているライブラリだけでなく、その下位の依存関係にも数多くの部品を抱えています。表面的には安全に見えても、深い階層に脆弱なコンポーネントが含まれていることは珍しくありません。

SBOMの未整備

SBOMが未整備だと、こうした影響範囲調査に時間がかかり、対応の遅れにつながります。

クラウド環境の可視化不足

クラウドでは、責任分界が従来のオンプレミスとは異なり、サービス形態によって利用者側の責任範囲が変わります。そのため、「クラウド事業者が面倒を見ているはず」と誤解してしまうと、更新漏れや設定不備を放置しやすくなります。共有責任モデルを前提に、自社の管理範囲を明確にしなければ、脆弱性管理は形骸化します。

OSS利用時に重要な脆弱性管理(SBOMの活用)

OSSの活用は、開発効率や品質向上の面で大きなメリットがありますが、その一方で脆弱性管理を複雑にします。理由は明快で、企業が自分で一から書いていないコードであっても、最終的に自社サービスや製品の一部として責任を負うからです。OSS由来の脆弱性は、アプリケーション本体ではなく依存パッケージに潜んでいることも多く、目視や台帳だけで追いきるのは現実的ではありません。

ここで重要になるのがSBOMです。NTIAはSBOMを、ソフトウェアを構成する各種コンポーネントとサプライチェーン上の関係を記録する正式な記録と定義しています。これを整備しておけば、新たな脆弱性が公表された際に、「自社のどのシステムに、その部品が含まれているか」を調べやすくなります。結果として、影響調査の初動が速くなり、不要な全件調査や属人的な確認作業を減らせます。

SBOMは、単に監査対応のために作る資料ではありません。脆弱性管理の実務で使えてこそ意味があります。たとえば、SCAツールで依存関係を検出し、その情報をSBOMとして管理し、脆弱性公表時に突合するという流れが定着すれば、OSS脆弱性への対応速度と精度を高めやすくなります。今後の企業システムでは、OSS利用時の脆弱性管理をSBOM抜きで考えることは難しくなっていくでしょう。

脆弱性管理を効率化する方法

脆弱性管理を効率化する方法はいくつかあります。

資産管理の自動化

資産台帳を手作業で維持する運用では、クラウドやコンテナ、SaaSの増減に追いつけません。CMDB、クラウド資産可視化、ID管理、EDRやMDMの情報などを組み合わせて、現時点の資産情報を継続的に更新できる状態を目指す必要があります。資産情報が整えば、脆弱性情報との突合精度も上がります。

OSS脆弱性監視

OSS脆弱性監視の仕組みを作ることも重要です。開発時点だけでなく、運用中のアプリケーションについても、依存ライブラリの脆弱性を継続監視しなければなりません。脆弱性管理をインフラ部門だけの仕事にせず、開発部門やDevOps運用の中に組み込むことが、今の実務では不可欠です。

SBOMによるソフトウェア構成管理

SBOMによるソフトウェア構成管理を取り入れることで、影響調査の速度と精度をさらに高められます。SBOMが整っていれば、新たなCVEが公表された際にも、対象ソフトウェアの所在確認を短時間で進めやすくなります。加えて、KEVのような実悪用情報を監視し、CVSSだけでなく悪用実績も含めて優先順位を決める運用にすれば、限られた人員でも効果的に対応しやすくなります。脆弱性管理を効率化するとは、単にツールを増やすことではなく、「見つける」「判断する」「直す」を早く回せる仕組みへ変えることです。

まとめ

脆弱性管理とは、脆弱性を発見する作業ではなく、自社のIT資産、クラウド環境、OSSコンポーネントを継続的に把握し、影響を判断し、優先順位をつけて修正し、再確認する運用そのものです。2026年の企業環境では、オンプレミスだけを見ていては不十分で、クラウド、SaaS、コンテナ、OSSまで含めた視点が欠かせません。とくに、実際に悪用される脆弱性への対応と、SBOMを活用したソフトウェア構成の可視化は、これからの脆弱性管理の重要な柱になります。

まず取り組むべきなのは、完璧な仕組みを一気に作ることではなく、自社の資産を洗い出し、脆弱性情報を収集し、優先度を判断し、修正後に確認するという基本サイクルを止めずに回すことです。そのうえで、クラウド可視化、SCA、SBOM管理などを段階的に取り入れていけば、脆弱性管理は現場で機能する実践的な仕組みに育っていきます。

BBSecでは

BBSecでは以下のようなご支援が可能です。 お客様のご状況に合わせて最適なご提案をいたします。

自ステムの状態を知る

SQAT®脆弱性診断サービス

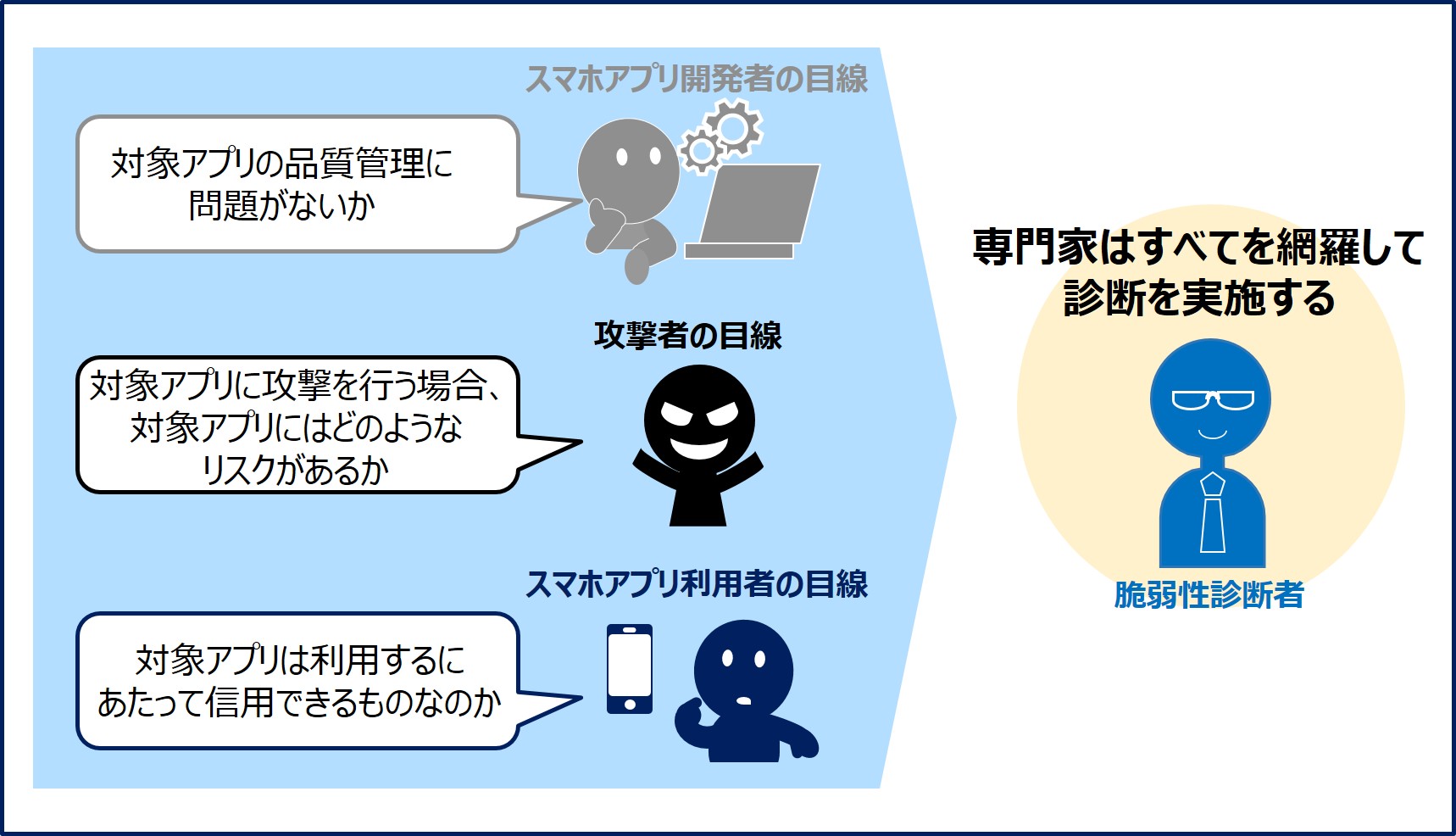

サイバー攻撃に対する備えとして、BBSecが提供する、SQAT脆弱性診断サービスでは、攻撃者の侵入を許す脆弱性の存在が見逃されていないかどうかを定期的に確認することができます。自組織の状態を知り、適切な脆弱性対策をすることが重要です。

アタックサーフェス調査サービス

インターネット上で「攻撃者にとって対象組織はどう見えているか」調査・報告するサービスです。攻撃者と同じ観点に立ち、企業ドメイン情報をはじめとする、公開情報(OSINT)を利用して攻撃可能なポイントの有無を、弊社セキュリティエンジニアが調査いたします。

ウェビナー開催のお知らせ

- 2026年4月15日(水)14:00~15:00「AI時代のサイバー脅威最前線 ― IPA『情報セキュリティ10大脅威2026』から学ぶ防御戦略 ―」

- 2026年4月22日(水)14:00~14:30「Swift CSCF v2026変更点解説セミナー

― Control 2.4 (Back Office Data Flow Security)の必須化とCustomer client connectorへの要件適用拡大 ―」 - 2026年5月13日(水)14:00~15:00「攻撃は本当に成立するのか?ペネトレーションテストで検証する実践的セキュリティ対策(デモ解説)」

最新情報はこちら

編集責任:木下

Security NEWS TOPに戻る

バックナンバー TOPに戻る